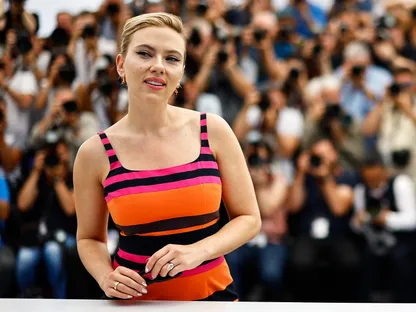

في خطوة جريئة وهامة، قررت الممثلة الهوليوودية سكارليت جوهانسون منع OpenAI من استخدام صوتها في إنشاء الكلام الاصطناعي.

وأثار هذا القرار نقاشات في مختلف القطاعات، مسلطاً الضوء على قضايا هامة تتعلق بالأخلاقيات الرقمية، والخصوصية الشخصية، ومستقبل الذكاء الاصطناعي.

سكارليت جوهانسون، المعروفة بأدوارها الأيقونية وصوتها المميز، أصبحت أحدث شخصية رفيعة المستوى تتخذ موقفاً ضد استخدام صوتها من قبل تقنيات الذكاء الاصطناعي بدون موافقة صريحة. وجاء القرار بعد أن علمت جوهانسون أن صوتها يتم استخدامه بواسطة تقنيات الذكاء الاصطناعي دون موافقتها، مما أثار مخاوف حول إساءة استخدام البيانات الشخصية وحقوق الملكية الفكرية.

وأثار الاستخدام غير المصرح به لصوتها أثار أسئلة قانونية وأخلاقية، وشددت جوهانسون على أهمية الموافقة وحق التحكم في الشكل والصوت الشخصي في العصر الرقمي.

تداعيات أوسع على الذكاء الاصطناعي والحقوق الرقمية

موقف جوهانسون لا يقتصر فقط على حماية حقوقها الخاصة، بل يضع أيضاً سابقة لكيفية التعامل مع الحقوق الرقمية في عصر الذكاء الاصطناعي. وقد يكون لقرارها تداعيات واسعة النطاق على مختلف أصحاب المصلحة، بما في ذلك المشاهير، وشركات التكنولوجيا، وصناع السياسات.

التأثير على المشاهير والشخصيات العامة

حماية البيانات الشخصية: تسلط خطوة جوهانسون الضوء على الحاجة إلى تشريعات أقوى لحماية الهويات الرقمية للأفراد.

سابقة للإجراءات القانونية: قد يمهد هذا القرار الطريق أمام مشاهير آخرين لاتخاذ إجراءات مماثلة، مما قد يؤدي إلى موجة من الدعاوى القضائية وتنظيمات أشد.

التداعيات على شركات التكنولوجيا

تطوير أخلاقيات الذكاء الاصطناعي: قد تحتاج شركات مثل OpenAI إلى إعادة تقييم ممارساتها والتأكد من الحصول على موافقة صريحة قبل استخدام البيانات الشخصية.

الامتثال التنظيمي: قد تواجه شركات التكنولوجيا تدقيقاً متزايداً وتنظيمات أشد فيما يتعلق باستخدام البيانات والخصوصية.

مستقبل الذكاء الاصطناعي والاعتبارات الأخلاقية

قرار سكارليت جوهانسون يسلط الضوء على الأهمية المتزايدة للاعتبارات الأخلاقية في تطوير الذكاء الاصطناعي. مع تطور تقنيات الذكاء الاصطناعي وتوسعها، يصبح من الضروري تطوير أطر أخلاقية قوية ولوائح لحماية الأفراد في العصر الرقمي.

القضايا الأخلاقية الرئيسية:

الموافقة والملكية: من الضروري وضع إرشادات واضحة حول الموافقة والملكية للبيانات الرقمية لمنع إساءة استخدامها.

الشفافية: يجب أن تكون شركات الذكاء الاصطناعي شفافة حول كيفية جمع واستخدام البيانات، مع ضمان إبلاغ المستخدمين بالكامل.

نظرة مستقبلية

تشريعات معززة: قد تقدم الحكومات في جميع أنحاء العالم قوانين أكثر صرامة لحماية الحقوق الرقمية، مستوحاة من قضايا بارزة مثل قضية جوهانسون.

معايير أخلاقية للذكاء الاصطناعي: من المحتمل أن يكون هناك دفع نحو تطوير وتبني معايير أخلاقية للذكاء الاصطناعي تركز على موافقة المستخدم وحماية البيانات.

في النهاية: يمثل قرار سكارليت جوهانسون منع OpenAI من استخدام صوتها لحظة محورية في تقاطع الذكاء الاصطناعي والحقوق الرقمية. ويسلط الضوء على الحاجة الملحة لتطوير أطر أخلاقية وتشريعات أقوى لحماية الأفراد في العصر الرقمي.

ومع استمرار تطور الذكاء الاصطناعي، سيكون من الأساسي ضمان أن تتماشى الاعتبارات الأخلاقية مع التطورات التكنولوجية لحماية الخصوصية الشخصية والحفاظ على ثقة الجمهور. قد تلهم خطوة جوهانسون الجريئة حركة أوسع نحو ممارسات الذكاء الاصطناعي الأخلاقية، مما يمهد الطريق لمستقبل أكثر وعياً وتنظيماً في التكنولوجيا.

تنويه

- هذه القصة مكتوبة بواسطة الذكاء الاصطناعي، بناءً على أسئلة من "الشرق"، ضمن تجربة لاختبار إمكانيات استخدام أدوات الذكاء الاصطناعي في مجال الكتابة وصناعة المحتوى.

- أنتجَ النص ChatGPT باللغة الإنجليزية، ثم ترجمته المنصة نفسها إلى اللغة العربية.

- القصة المنشورة لم تخضع لتدخل تحريري بشري إلّا في حدود التأكد من دقة الترجمة واختيار العنوان.