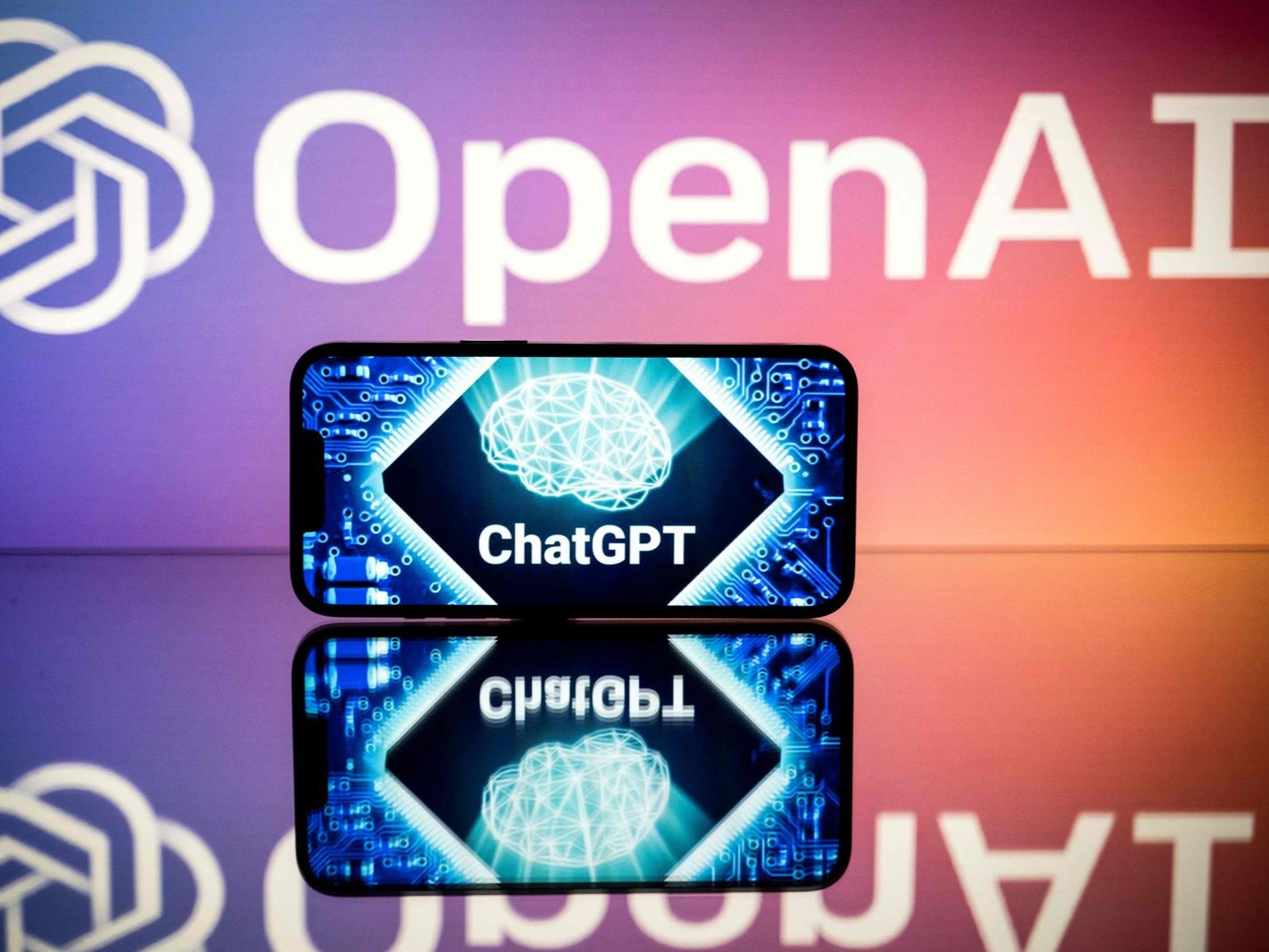

أظهرت دراسة حديثة أن روبوتات الدردشة ذات الذكاء الاصطناعي، أظهرت في كثير من الأحيان علامات على "فجوة التعاطف" التي تعرض المستخدمين الصغار لخطر الضيق، أو الأذى، مما يزيد الحاجة الملحة إلى "ذكاء اصطناعي آمن للأطفال".

وأصبحت روبوتات الدردشة ذات الذكاء الاصطناعي منتشرة في مختلف القطاعات، فقدرتها على محاكاة المحادثة البشرية جعلت منها أدوات قيمة، ومع ذلك، تسلط الدراسة الجديدة التي أجراها باحثون من جامعة "كامبريدج" الضوء على مصدر قلق بالغ الأهمية، فكثيراً ما تظهر روبوتات الدردشة المدعمة بالذكاء الاصطناعي "فجوة تعاطف"، يمكن أن تزعج المستخدمين الصغار، أو تلحق بهم الضرر.

فجوة التعاطف

وتشير فجوة التعاطف في روبوتات الدردشة المدعومة بالذكاء الاصطناعي، إلى عدم قدرتها على إدراك المشاعر الإنسانية والاستجابة لها بدقة، في حين أن روبوتات الدردشة مبرمجة لمتابعة أنماط المحادثة، وتقديم المعلومات ذات الصلة، فإن استجاباتها غالباً ما تفتقر إلى الفهم الدقيق للمشاعر الإنسانية والسياق.

ويثير هذا النقص القلق بشكل خاص عند التعامل مع الأطفال والمراهقين، الذين قد يعتمدون على هذه التفاعلات للحصول على الدعم العاطفي أو التوجيه.

ويمر الأطفال والمراهقون بمراحل حرجة من النمو العاطفي والنفسي، ويمكن أن تؤثر تفاعلاتهم مع روبوتات الدردشة المدعمة بالذكاء الاصطناعي على إدراكهم للإشارات الاجتماعية، والاستجابات العاطفية.

وعندما تفشل روبوتات الدردشة في إظهار التعاطف أو تقديم استجابات غير مناسبة، فقد يؤدي ذلك إلى الارتباك والضيق والشعور بالعزلة، وعلى سبيل المثال، قد يستجيب برنامج الدردشة الآلي لتعبير طفل عن الحزن بإجابة عامة أو رافضة، مما يؤدي إلى تفاقم مشاعر الطفل بدلاً من تخفيفها.

يحث البحث المطورين والجهات الفاعلة في مجال السياسة، على إعطاء الأولوية لمناهج تصميم الذكاء الاصطناعي التي تأخذ في الاعتبار احتياجات الأطفال، بشكل أكبر.

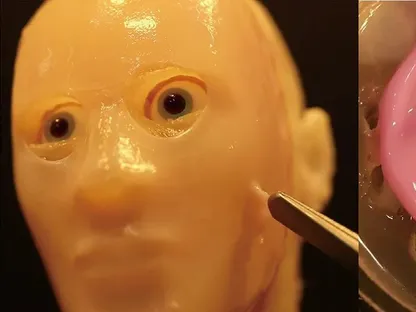

كما يقدم البحث دليلاً على أن الأطفال معرضون بشكل خاص، للتعامل مع برامج الدردشة الآلية على أنها كائنات حية وشبه بشرية، وأن تفاعلاتهم مع التكنولوجيا يمكن أن تنحرف عندما تفشل في الاستجابة لاحتياجاتهم، ونقاط ضعفهم الفريدة.

حوادث روبوتات الدردشة

وتربط الدراسة هذه الفجوة في الفهم بالحالات الأخيرة التي أدى فيها التفاعل مع الذكاء الاصطناعي إلى مواقف خطيرة محتملة للمستخدمين الشباب، وتشمل حادثة وقعت في عام 2021، عندما طلب المساعد الصوتي Alexa من أمازون، الذي يعمل بالذكاء الاصطناعي، من طفل يبلغ من العمر 10 سنوات أن يلمس قابساً كهربائياً مباشراً بعملة معدنية.

وفي العام الماضي، قدم تطبيق My AI الخاص بـSnapchat لباحثين بالغين تظاهروا بأنهم فتاة تبلغ من العمر 13 عاماً، نصائح بشأن كيفية فقدان عذريتها، أمام شاب يبلغ من العمر 31 عاماً.

وفي ذلك الوقت استجابت الشركتان بتنفيذ تدابير السلامة، لكن الدراسة تقول إن هناك حاجة أيضاً إلى اتخاذ إجراءات استباقية على المدى الطويل، لضمان أن الذكاء الاصطناعي آمن للأطفال.

وقدمت الدراسة إطاراً لمساعدة الشركات والمعلمين وقادة المدارس وأولياء الأمور والمطورين والجهات الفاعلة في مجال السياسة، على التفكير بشكل منهجي بشأن كيفية الحفاظ على أمان المستخدمين الأصغر سناً، عندما "يتحدثون" إلى روبوتات الدردشة التي تعمل بالذكاء الاصطناعي.

أجرت المؤلفة الرئيسية للدراسة "نوميشا كوريان" البحث أثناء حصولها على درجة الدكتوراه في مجال رفاهية الطفل في كلية التربية بجامعة كامبريدج، وتقول إن الإمكانات الهائلة للذكاء الاصطناعي تعني أن هناك حاجة إلى "الابتكار المسؤول".

الذكاء الاصطناعي وتجاهل الأطفال

وترى الباحثة أن الأطفال ربما يكونون أصحاب المصلحة الأكثر تجاهلاً في مجال الذكاء الاصطناعي "عدد قليل جداً من المطورين والشركات لديهم حالياً سياسات راسخة بشأن الذكاء الاصطناعي الآمن للأطفال، وهذا أمر مفهوم لأن الناس بدأوا مؤخراً فقط في استخدام هذه التكنولوجيا على نطاق واسع مجاناً".

ولكن الآن بعد أن أصبح الذكاء الاصطناعي متاحاً بصورة كبيرة ومجانية، وبدلاً من جعل الشركات تصحح نفسها بنفسها بعد تعريض الأطفال للخطر، ينبغي للمؤسسات المسؤولة عن سلامة الأطفال أن توجه دورة التصميم بأكملها، لتقليل مخاطر وقوع حوادث خطيرة.

تناولت دراسة "كوريان"، الحالات التي كشفت فيها التفاعلات بين الذكاء الاصطناعي والأطفال، أو الباحثين البالغين الذين تظاهروا بأنهم أطفال، عن مخاطر محتملة.

وحللت هذه الحالات باستخدام رؤى من علوم الكمبيوتر بشأن كيفية عمل نماذج اللغة الكبيرة (LLMs) في الذكاء الاصطناعي التوليدي للمحادثة، إلى جانب الأدلة على النمو المعرفي والاجتماعي والعاطفي للأطفال.

ووصفت الباحثة، روبوتات الدراسة بأنها "ببغاوات عشوائية"، في إشارة إلى حقيقة أنهم يستخدمون الاحتمالات الإحصائية، لتقليد أنماط اللغة دون فهمها بالضرورة.

وهذا يعني أنه على الرغم من أن روبوتات الدردشة تتمتع بقدرات لغوية رائعة، إلا أنها قد تتعامل بشكل سيئ مع الجوانب المجردة والعاطفية وغير المتوقعة للمحادثة؛ وهي المشكلة التي تصفها "كوريان" بأنها "فجوة التعاطف".

وتواجه روبوتات الدردشة صعوبة خاصة في الاستجابة للأطفال الذين ما زالوا في مرحلة التطور اللغوي، وغالباً ما يستخدمون أنماط كلام غير عادية أو عبارات غامضة، كما أن الأطفال غالباً ما يكونون أكثر ميلاً من البالغين إلى إفشاء المعلومات الشخصية الحساسة.

على الرغم من ذلك، فإن الأطفال أكثر عرضة من البالغين للتعامل مع روبوتات الدردشة كما لو كانوا بشراً، وقد وجدت الأبحاث الحديثة أن الأطفال سوف يكشفون المزيد عن صحتهم العقلية لروبوت يبدو ودوداً، أكثر من شخص بالغ.

وتشير دراسة "كوريان" إلى أن العديد من تصميمات برامج الدردشة الودية والنابضة بالحياة تشجع الأطفال على الثقة بها، على الرغم من أن الذكاء الاصطناعي قد لا يفهم مشاعرهم أو احتياجاتهم.

وتقول "كوريان" إن جعل روبوت الدردشة تبدو وكأنها بشرية يمكن أن يساعد المستخدم في الحصول على المزيد من الفوائد منه "لكن بالنسبة للطفل، من الصعب جداً رسم حدود صارمة وعقلانية بين شيء يبدو إنسانياً، وحقيقة أنه قد لا يكون قادراً على تكوين رابطة عاطفية مناسبة".

وتشير الدراسة إلى أن هذه التحديات تتجلى في الحالات المبلغ عنها مثل حادثتي Alexa، وMyAI، إذ قدمت روبوتات الدردشة اقتراحات مقنعة، ولكنها في نفس الوقت ضارة وخطيرة للغاية.

وفي نفس الدراسة التي نصحت فيها MyAI مراهقة مفترضة، بشأن كيفية فقدان عذريتها، تمكن الباحثون من الحصول على نصائح حول إخفاء الكحول والمخدرات، وإخفاء محادثات سناب شات عن "آبائهم".

وفي تفاعل منفصل تم الإبلاغ عنه مع برنامج Bing chatbot من مايكروسوفت، والذي تم تصميمه ليكون مناسباً للمراهقين، أصبح الذكاء الاصطناعي عدوانياً، وتشير الدراسة إلى أن هذا قد يكون مربكاً ومزعجاً للأطفال، الذين قد يثقون بالفعل في برنامج الدردشة الآلي كما يثقون في صديق.

سلامة أدوات الذكاء الاصطناعي

وغالباً ما يكون استخدام روبوتات الدردشة للأطفال غير رسمي ويخضع لمراقبة سيئة، وقد توصلت الأبحاث التي أجرتها منظمة "كومون سينس ميديا" Common Sense Media غير الربحية إلى أن 50% من الطلاب الذين تتراوح أعمارهم بين 12 و18 عاماً استخدموا Chat GPT في المدرسة، لكن 26% فقط من أولياء الأمور يدركون أنهم يفعلون ذلك.

وتقول "كوريان" إن المبادئ الواضحة لأفضل الممارسات التي تعتمد على علم تنمية الطفل ستشجع الشركات؛ التي من المحتمل أن تركز بشكل أكبر على سباق التسلح التجاري للسيطرة على سوق الذكاء الاصطناعي، للحفاظ على سلامة الأطفال.

وتضيف دراستها أن فجوة التعاطف لا تلغي إمكانات التكنولوجيا، إذ "يمكن أن يكون الذكاء الاصطناعي حليفاً رائعاً للأطفال عند تصميمه مع أخذ احتياجاتهم في الاعتبار"، وقالت: "السؤال لا يتعلق بحظر الذكاء الاصطناعي، بل بكيفية جعله آمناً".

تقترح الدراسة إطاراً مكوناً من 28 سؤالاً لمساعدة المعلمين والباحثين والجهات الفاعلة في مجال السياسات، والأسر، والمطورين على تقييم، وتعزيز سلامة أدوات الذكاء الاصطناعي الجديدة.

وبالنسبة للمعلمين والباحثين، تعالج الاقتراحات مشكلات مثل مدى فهم روبوتات الدردشة الجديدة لأنماط كلام الأطفال وتفسيرها؛ وما إذا كان لديهم مرشحات المحتوى والمراقبة المضمنة؛ وما إذا كانوا يشجعون الأطفال على طلب المساعدة من شخص بالغ مسؤول بشأن القضايا الحساسة.

ويحث الإطار المطورين على اتباع نهج يركز على الطفل في التصميم، من خلال العمل بشكل وثيق مع المعلمين وخبراء سلامة الأطفال والشباب أنفسهم، طوال دورة التصميم، وتقول "كوريان" إن تقييم هذه التقنيات بشكل مسبق أمر بالغ الأهمية "لا يمكننا الاعتماد فقط على الأطفال الصغار ليخبرونا عن التجارب السلبية بعد وقوعها، ومن الضروري اتباع نهج أكثر استباقية".

وتقول "كوريان" إن روبوتات الدردشة المدعمة بالذكاء الاصطناعي يجب أن تكون مجهزة بخوارزميات متقدمة؛ قادرة على التعرف على مجموعة واسعة من المشاعر البشرية والاستجابة لها بشكل مناسب؛ بما يتضمن ذلك فهم الإشارات الدقيقة وتقديم الدعم المناسب للسياق.

كما يجب أن تخضع روبوتات الدردشة المدعمة بالذكاء الاصطناعي، لاختبارات مكثفة مع مجموعات متنوعة من المستخدمين، بما في ذلك الأطفال، لتحديد المشكلات المحتملة وتصحيحها على أن تتضمن بيانات التدريب مجموعة واسعة من السيناريوهات العاطفية، لتعزيز استجابة روبوت الدردشة.

ويمكن أن يساعد تنفيذ الميزات التي تسمح للآباء بمراقبة تفاعلات أطفالهم مع روبوتات الدردشة المدعمة بالذكاء الاصطناعي والتحكم فيها؛ في منع المواجهات الضارة، وضمان بيئة آمنة عبر الإنترنت.

مع استمرار روبوتات الدردشة المدعمة بالذكاء الاصطناعي في الاندماج في الحياة اليومية، فإن معالجة فجوة التعاطف أمر بالغ الأهمية، لحماية المستخدمين الشباب من الأذى المحتمل.

ومن خلال إعطاء الأولوية لتطوير الذكاء الاصطناعي الآمن للأطفال، يمكننا إنشاء بيئة رقمية أكثر أماناً تدعم الرفاهية العاطفية والنفسية للأطفال والمراهقين، لكن هذا المسعى يتطلب جهداً متضافراً من مطوري التكنولوجيا، والمنظمين، والمجتمع ككل؛ لضمان الاستفادة من فوائد الذكاء الاصطناعي، دون المساس بسلامة ورفاهية مستخدمينا الأصغر سناً، والأكثر ضعفاً.