مع الانتشار المتسارع لتقنيات الذكاء الاصطناعي في إنتاج المحتوى العلمي والإخباري على الإنترنت، أصبحت مسألة الشفافية في الإشارة إلى المحتوى المنشأ آلياً محور نقاش واسع على الصعيدين التنظيمي والإعلامي.

واعتمدت العديد من الحكومات والمنصات الرقمية سياسات تُلزم بوضع علامات توضيحية على المنشورات المولّدة بالذكاء الاصطناعي، بهدف حماية الجمهور من التضليل.

إلا أن دراسة جديدة نُشرت في مجلة JCOM المتخصصة في التواصل العلمي، تشير إلى أن هذه الإجراءات قد تفضي إلى نتائج عكسية، إذ يمكن أن تقلل من ثقة الجمهور بالمعلومات العلمية الصحيحة، بينما تعزز في الوقت ذاته مصداقية المعلومات الخاطئة.

وتأتي هذه النتائج في ظل اعتماد متزايد على النماذج اللغوية المتقدمة في كتابة النصوص العلمية أو تبسيطها للجمهور العام. فرغم الفوائد الكبيرة لهذه التقنيات، إلا أنها تحمل مخاطر محتملة، إذ قد تنتج أحياناً معلومات غير دقيقة تبدو مقنعة للغاية، فيما يُعرف بـ"هلوسة الذكاء الاصطناعي"، كما يمكن استغلالها عمداً لتوليد محتوى مضلل بأسلوب علمي يصعب على القارئ العادي كشف زيفه.

وفي محاولة لفهم تأثير علامات الإفصاح عن المحتوى المولّد بالذكاء الاصطناعي، أجرى الباحثان تينج لين، ويي تشينج تشانج، من كلية الصحافة والاتصال في جامعة الأكاديمية الصينية للعلوم الاجتماعية دراسة تجريبية لاختبار مدى فاعلية هذه العلامات في الحد من انتشار المعلومات المضللة.

وشملت الدراسة 433 مشاركاً، جرى تجنيدهم عبر منصة إلكترونية بين مارس ومايو 2024. وصمّم الباحثان أربع فئات من منشورات وسائل التواصل الاجتماعي: معلومات علمية صحيحة مصحوبة بعلامة توضح أنها مولّدة بالذكاء الاصطناعي، معلومات صحيحة بدون العلامة، معلومات مضللة مع العلامة، وأخرى مضللة بدونها.

وتمت صياغة المنشورات بأسلوب مشابه لمنشورات منصة "ويبو" الصينية، باستخدام نموذج "تشات جي بي تي-4"، واعتمد الباحثان على مواد مستمدة من منصة صينية متخصصة في دحض الشائعات العلمية.

طلب الباحثان من المشاركين تقييم مصداقية كل منشور على مقياس من 1 إلى 5، مع قياس مواقفهم تجاه الذكاء الاصطناعي واهتمامهم بالموضوعات المطروحة.

وكشفت النتائج عن ظاهرة مفاجئة أطلق عليها الباحثان اسم "تأثير التقاطع بين الحقيقة والزيف"، إذ أن وجود علامة تشير إلى أن المحتوى مولّد بالذكاء الاصطناعي أدى إلى نتيجتين متعاكستين: انخفضت مصداقية المعلومات الصحيحة، بينما ازدادت مصداقية المعلومات المضللة. بمعنى آخر، لم تساعد هذه العلامات المشاركين على التمييز بين الحقيقة والخطأ، بل أعادت توزيع الثقة بشكل غير متوقع.

"النفور من الخوارزميات"

كما أظهرت الدراسة أن المواقف الشخصية تجاه الذكاء الاصطناعي تلعب دوراً محورياً في تفسير النتائج. فالأفراد الذين ينظرون إلى الذكاء الاصطناعي بعين الشك كانوا أكثر ميلاً لتقليل تقييمهم للمعلومات الصحيحة عند معرفة أنها مولّدة آلياً، بينما لم يختف التأثير الإيجابي للعلامة على مصداقية المعلومات المضللة تماماً، بل انخفض جزئياً فقط.

وأوضحت النتائج أن ما يُعرف بـ"النفور من الخوارزميات" لا يؤدي إلى رفض شامل للمحتوى المولّد بالذكاء الاصطناعي، بل يخلق ردود فعل متباينة حسب طبيعة المعلومات وسياقها.

وتحمل هذه الدراسة دلالات مهمة لصانعي السياسات والمنصات الرقمية التي تسعى لتنظيم المحتوى الناتج عن الذكاء الاصطناعي. فبدلاً من الاكتفاء بوضع علامة بسيطة تشير إلى أن النص مولّد آلياً، يقترح الباحثون اعتماد نظام تصنيف أكثر تعقيداً يأخذ في الاعتبار طبيعة المعلومات ومستوى المخاطر المرتبطة بها.

ومن بين المقترحات اعتماد نظام مزدوج للوسم، لا يكتفي بالإشارة إلى أن المحتوى مولّد بالذكاء الاصطناعي، بل يضيف تنبيهاً يوضح ما إذا كانت المعلومات قد خضعت للتحقق المستقل.

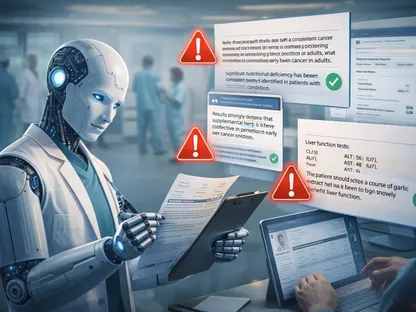

كما يقترح الباحثون استخدام درجات تحذير متفاوتة حسب نوع المحتوى، بحيث تحظى المعلومات الطبية والصحية - التي تؤثر مباشرة على قرارات الأفراد - بتحذيرات أقوى مقارنة بالمحتوى الأقل حساسية مثل الأخبار التقنية.

وفي ظل الانتشار المتسارع للذكاء الاصطناعي في إنتاج وتداول المعرفة، تؤكد الدراسة أن الشفافية وحدها قد لا تكفي لمكافحة التضليل، بل تحتاج السياسات إلى تصميم دقيق يراعي الطريقة التي يتفاعل بها الجمهور مع التكنولوجيا والمعلومات في العصر الرقمي.