استخدم الجيش الإسرائيلي في حملة القصف الجوي على قطاع غزة قاعدة بيانات مدعومة بنظام ذكاء اصطناعي لم يكشف عنها سابقاً، حددت في إحدى المراحل 37 ألف فلسطيني كأهداف محتملة للاغتيال، حسبما ذكرت مصادر استخباراتية مشاركة في الحرب لمجلة "972+" الإسرائيلية.

وكشفت المجلة أن الجيش الإسرائيلي حدد "عشرات الآلاف" من سكان غزة باعتبارهم "أهدافاً مشتبه بهم من أجل اغتيالهم"، باستخدام نظام يُعرف باسم "لافندر" يعمل بتقنية الذكاء الاصطناعي مع القليل من الإشراف البشري، واتباع "سياسات متساهلة"، فيما يتعلق بعدد الضحايا المدنيين.

وفي تعليق على هذا التقرير، قال منسق الاتصالات الاستراتيجية بمجلس الأمن القومي في البيت الأبيض جون كيربي، في مقابلة مع شبكة CNN، الخميس، إن الولايات المتحدة تراجع هذه المعلومات.

كيف بدأت الفكرة؟

في عام 2021، صدر كتاب باللغة الإنجليزية بعنوان "فريق الإنسان والآلة: كيفية خلق تناغم بين الذكاء البشري والذكاء الاصطناعي لإحداث ثورة في عالمنا"، وفي هذا الكتاب طرح المؤلف، وهو القائد الحالي لوحدة استخبارات النخبة الإسرائيلية 8200، مسألة تصميم آلة خاصة يمكنها معالجة كميات هائلة من البيانات بسرعة للتوصل لآلاف الأهداف المحتملة للضربات العسكرية أثناء الحرب.

ورأى أن مثل هذه التكنولوجيا ستحل ما وصفه بـ"عنق الزجاجة البشري، الذي يحول دون تحديد الأهداف الجديدة واتخاذ القرار للموافقة عليها".

وكشف تحقيق أجرته المجلة أن هذه الآلة موجودة بالفعل، وأن الجيش الإسرائيلي طوّر برنامجاً قائماً على الذكاء الاصطناعي.

كيف يعمل نظام "لافندر"؟

تضمن التحقيق 6 محاور، أولها شرح طريقة عمل نظام "لافندر" الذي حدد عشرات الآلاف من الفلسطينيين باستخدام الذكاء الاصطناعي، وثانياً طريقة نظام "أين أبي؟" الذي قام بتتبع هذه الأهداف وإبلاغ الجيش عند دخولهم منازل عائلاتهم، وثالثاً كيفية اختيار ذخائر غير موجهة تعرف باسم "القنابل الغبية" لضرب هذه المنازل.

كما تضمن التحقيق طريقة خفض الجيش العدد المسموح بقتله من المدنيين أثناء قصف هدف ما، وكذلك كيفية احتساب البرامج الآلية عدد غير المقاتلين في كل أسرة بشكل غير دقيق، وأخيراً كيف أنه في عدة مناسبات لم يكن الهدف في بعض الأحيان موجوداً داخل المنزل عندما يُقصف، وهو ما يكون عادةً في الليل، لأن ضباط الجيش لم يتحققوا من المعلومات في الوقت الفعلي.

وقدم 6 ضباط استخبارات إسرائيليين، شاركوا جميعاً بشكل مباشر في استخدام أنظمة الذكاء الاصطناعي لتحديد أهداف حركتي "حماس" و"الجهاد" في الحرب، شهاداتهم إلى الصحافي يوفال أبراهام في تقرير مجلة "+972"، التي شاركت شهاداتهم مع صحيفة "الجارديان" البريطانية قبل النشر.

وذكرت المصادر أن المسؤولين العسكريين الإسرائيليين "سمحوا بقتل أعداد كبيرة من المدنيين الفلسطينيين، خاصةً خلال الأسابيع والأشهر الأولى من الحرب".

"20 ثانية" قبل الإذن بالقصف

وأوضح التقرير أن البرنامج لعب دوراً مركزياً في القصف غير المسبوق الذي تعرض له الفلسطينيون في قطاع غزة، خاصةً في المراحل الأولى من الحرب، وبحسب المصادر، كان يؤثر بشكل كبير على عمليات الجيش لدرجة أنهم تعاملوا مع مخرجاته كما لو كانت "نابعة عن قرارات بشرية".

وصُمم نظام "لافندر" لتحديد "المقاتلين" المشتبه في انتمائهم إلى الأجنحة العسكرية التابعة لحركتي "حماس" و"الجهاد"، بما في ذلك العناصر ذات الرتب المنخفضة، كأهداف محتملة للاغتيال.

وقالت المصادر إن الجيش، خلال الأسابيع الأولى من الحرب، اعتمد بشكل شبه كامل على هذا النظام الذي سجّل ما يصل إلى 37 ألف فلسطيني كمشتبه بهم، ومنازلهم، لشن غارات جوية محتملة.

وخلال المراحل الأولى من الحرب، أعطى الجيش الإسرائيلي موافقة واسعة النطاق للضباط على اعتماد قوائم القتل التي وضعها "لافندر" دون الحاجة إلى التحقق بدقة أكبر من سبب قيام الآلة بهذه الاختيارات أو فحص بيانات استخباراتية أولية استندت إليها.

وذكر أحد المصادر أنه غالباً ما كان يجري التعامل مع الأفراد البشريين باعتبارهم مجرد ختم بالموافقة على قرارات البرنامج، مضيفاً أنهم عادةً ما يخصصون نحو 20 ثانية فقط لكل هدف قبل الإذن بالقصف، وذلك فقط للتأكد من أن الهدف المحدد من قبل البرنامج ذكر وليس أنثى، وذلك على الرغم من عِلمه بأن النظام يرتكب أخطاء في نحو 10% من الحالات، ومن المعروف أنه يقوم أحياناً أيضاً بتحديد أفراد ليس لهم سوى ارتباط ضعيف بالحركات الفلسطينية، أو ليست لهم أية صلة بها على الإطلاق.

وهاجم الجيش الإسرائيلي الأفراد المستهدفين بشكل ممنهج أثناء وجودهم في منازلهم، وعادةً في الليل أثناء وجود أسرهم بأكملها، وليس أثناء قيامهم بنشاط عسكري، وبحسب المصادر، يعود ذلك إلى أنه من الناحية الاستخباراتية كان من الأسهل تحديد مكان الأفراد في منازلهم الخاصة.

نظام "أين أبي؟"

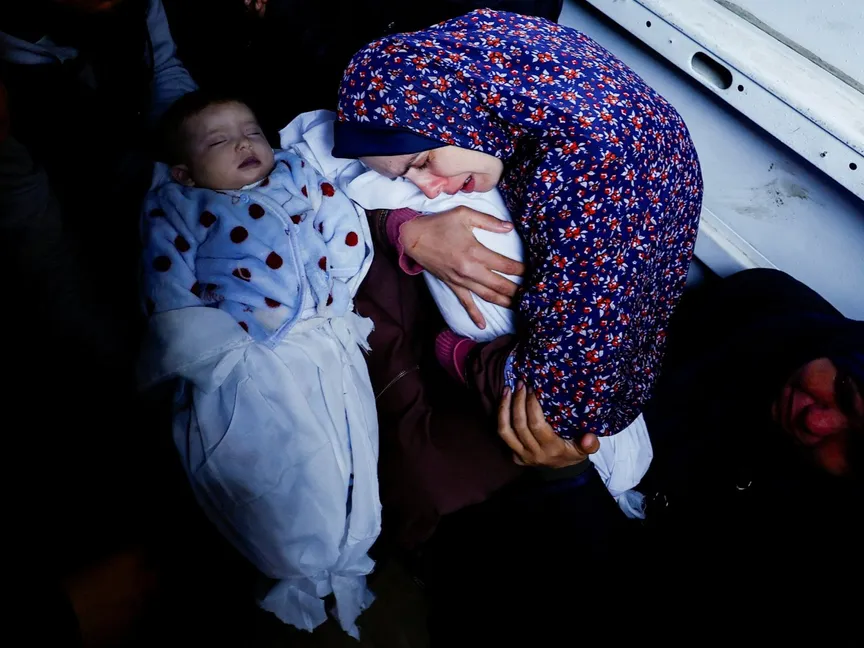

كما استخدم الجيش الإسرائيلي أيضاً نظاماً يسمى "أين أبي؟"، وذلك لتتبع الأفراد المستهدفين وتنفيذ التفجيرات عند دخولهم مساكن عائلاتهم، والنتيجة، وفقاً لشهادات المصادر، هي القضاء على آلاف الفلسطينيين، معظمهم من النساء والأطفال، أو الأشخاص الذين لم ينخرطوا في القتال، بسبب الغارات الجوية الإسرائيلية، خاصةً خلال الأسابيع الأولى من الحرب، بسبب قرارات برنامج الذكاء الاصطناعي.

ويقول أحد ضباط الاستخبارات للمجلة: "لم نكن مهتمين بقتل عناصر حماس فقط عندما يكونون داخل مبنى عسكري أو ينخرطون في نشاط عسكري، بل على العكس من ذلك، فقد قصف الجيش الإسرائيلي منازلهم كخيار أول دون تردد لأن من الأسهل بكثير قصف منزل العائلة".

كيف يعمل لافندر؟

ويعمل نظام "لافندر" بمساعدة نظام ذكاء اصطناعي آخر يسمى "The Gospel"، وكشفت المجلة معلومات عنه في تحقيق سابق أجرته في نوفمبر 2023، وكذلك في منشورات الجيش الإسرائيلي الخاصة.

ويكمن الاختلاف الأساسي بين النظامين في تعريف الهدف، فبينما يشير "The Gospel" إلى المباني والمنشآت التي يزعم الجيش أن المقاتلين يعملون منها، يحدد "لافندر" الأشخاص ويضعهم على قائمة الاغتيالات.

ووفقاً للمصادر، عندما يتعلق الأمر باستهداف صغار المقاتلين الذين يحددهم "لافندر"، كان الجيش يفضل استخدام الصواريخ غير الموجهة فقط، والمعروفة باسم "القنابل الغبية" (على عكس القنابل الدقيقة الذكية الموجهة)، التي يمكنها تدمير مبان بأكملها فوق ساكنيها، كما أنها تسبب خسائر كبيرة.

وقال مصدر إنهم سمحوا بقصف مئات المنازل الخاصة بالناشطين الصغار الذين حددهم "لافندر"، مشيراً إلى أن العديد من هذه الهجمات أدّت إلى سقوط مدنيين وعائلات بأكملها، واعتبرهم الجيش الإسرائيلي ضمن "الأضرار الجانبية" للحرب.

ما النهج الإسرائيلي الجديد بعد 7 أكتوبر؟

في الماضي، كان مصطلح "هدف بشري" يشير في الجيش الإسرائيلي إلى العملاء العسكريين الكبار الذين يمكن، وفقاً لقواعد القانون الدولي العسكري، قتلهم في منازلهم حتى لو كان هناك مدنيون حولهم.

ونقلت المجلة عن مصادر استخباراتية قولها إن إسرائيل، خلال الحروب السابقة، كانت تحدد هذه الأهداف البشرية بعناية فائقة، ولا تقصف المنازل سوى في حالة وجود كبار القادة العسكريين، وذلك للحفاظ على مبدأ التناسب بموجب القانون الدولي.

ولكن بعد 7 أكتوبر، اتخذ الجيش الإسرائيلي، بحسب المصادر، نهجاً مختلفاً تماماً في الحرب الحالية على غزة، حيث قرر استهداف جميع عناصر الجناح العسكري لحركة "حماس" باعتبارهم أهدافاً بشرية، بغض النظر عن رتبهم أو أهميتهم العسكرية.

ولكن هذه السياسة مثلت مشكلة فنية للاستخبارات الإسرائيلية، ففي الحروب السابقة، من أجل السماح باغتيال هدف بشري واحد كان يتعين على الضابط أن يمر بعملية معقدة وطويلة تتمثل في التحقق من الأدلة التي تثبت أن الشخص كان بالفعل عضواً بارزاً في الجناح العسكري لحماس، والعثور على معلومات عن المكان الذي يعيش فيه، ومعلومات عن الاتصالات الخاصة به، وأخيراً معرفة متى يكون بالمنزل في الوقت الفعلي.

ولكن مع توسع القائمة لتشمل عشرات الآلاف من النشطاء ذوي الرتب الأدنى، فقد رأى الجيش الإسرائيلي أنه يتعين الاعتماد على البرامج الآلية والذكاء الاصطناعي، وكانت النتيجة، كما تؤكد المصادر، تنحية دور الأفراد في تجريم الفلسطينيين باعتبارهم عملاء عسكريين، وترك المهمة لتقنية الذكاء الاصطناعي.

ووفقاً لأربعة مصادر تحدثت إلى المجلة، فإن برنامج "لافندر"، الذي تم تطويره لإنشاء أهداف بشرية في حرب غزة، حدد نحو 37 ألف فلسطيني على أنهم "مشتبه بهم تابعين لحماس"، ومعظمهم من صغار السن، لاغتيالهم، لكن المتحدث باسم الجيش الإسرائيلي نفى، في بيان للمجلة، وجود قائمة القتل هذه.

وأوضح أحد ضباط الاستخبارات الإسرائيلية: "لم نكن نعرف مَن هم صغار المقاتلين، لأن إسرائيل لم تكن تتعقبهم بشكل روتيني قبل الحرب، وقد أرادوا السماح لنا بمهاجمتهم على نحو آلي، وهو ما جعل تحديد الأهداف يصبح جنونياً".

من يوافق على قوائم لافندر؟

وقالت المصادر إنه تم منح الموافقة على اعتماد قوائم القتل الخاصة بـ"لافندر" بشكل تلقائي، بعد نحو أسبوعين من الحرب، علماً أنها كانت تُستخدم سابقاً فقط كأداة مساعدة.

ووجدت الاستخبارات الإسرائيلية أن نتائج البرنامج وصلت إلى دقة 90% في تحديد انتماء الفرد لحماس، وبعدها سمح الجيش بالاستخدام الشامل للنظام.

ومنذ تلك اللحظة، قالت المصادر إنه إذا قرر "لافندر" أن شخصاً ما كان مسلحاً تابعاً لحماس، فإنه يُطلب منهم التعامل مع ذلك باعتباره أمراً لا يحتاج إلى تحقق مستقل من سبب اختيار الآلة لهذا الشخص أو فحص البيانات الاستخباراتية الأولية التي تم الاعتماد عليها في اتخاذ القرار.

وقال ضابط استخبارات: "كانت القوات الجوية تأتي في الخامسة صباحاً، وتقصف جميع المنازل التي حددناها، فقد جرى تحديد آلاف الأشخاص، ولن نفحص كل منهم على حدة، بل وضعنا كل شيء في يد الأنظمة الآلية، وبمجرد أن يصبح أحد الأفراد المحددين في منزله، يصبح هدفاً على الفور، ويتم قصفه هو ومنزله".

وحول استخدام الذكاء الاصطناعي لتحديد "المقاتلين" المشتبه بهم ذوي الرتب المنخفضة، قال أحد المصادر: "كان من المفاجئ جداً بالنسبة لي أنه طُلب منّا قصف منزل لقتل ناشط كانت أهميته منخفضة للغاية في المعركة".

وتابع: "لذا أطلقت على هذه الأهداف اسم (أهداف بلا قيمة)، ومع ذلك، فقد وجدت قتل هؤلاء أكثر أخلاقية من الأهداف التي قمنا بقصفها فقط من أجل الردع، مثل المباني الشاهقة التي يتم إخلاؤها وإسقاطها فقط لإحداث الدمار".

نتائج لافندر

وقالت المجلة إن النتائج المميتة لهذا التخفيف من القيود في المرحلة الأولى من الحرب كانت صادمة، إذ قتلت إسرائيل نحو 15 ألف فلسطيني في الأسابيع الستة الأولى من الحرب، أي ما يقرب من نصف عدد الضحايا حتى الآن.

ويعمل برنامج "لافندر" على تحليل المعلومات التي يتم جمعها عن معظم سكان غزة البالغ عددهم 2.3 مليون نسمة من خلال نظام مراقبة جماعي، ثم يقوم بتقييم وتصنيف احتمالية أن يكون شخص معين ناشطاً في الجناح العسكري لحركتي "حماس" أو "الجهاد".

ووفقاً للمصادر، يعطي البرنامج كل شخص تقريباً في غزة تصنيفاً من 1 إلى 100، ما يعبر عن مدى احتمالية كونه ينتمي إلى هذه الحركات.

وأوضحت المصادر أن "لافندر" يتعلّم كيفية تحديد السمات المعروفة لنشطاء "حماس" و"الجهاد"، ثم تحديد موقع هذه السمات بين عامة السكان، ويحصل الشخص الذي يتبين أن لديه العديد من هذه السمات على تصنيف عالٍ، وبالتالي يصبح تلقائياً هدفاً محتملاً للاغتيال.

"فريق الإنسان والآلة"

وفي كتاب "فريق الإنسان والآلة"، المشار إليه في بداية التحقيق، كان الكاتب يدعو إلى تبني مثل هذا النظام دون الإشارة إلى "لافندر" بالاسم، واصفاً أفراد الجيش بأنهم "عنق الزجاجة" الذين يحدون من قدرة الجيش أثناء العمليات العسكرية.

وقال: "نحن البشر لا نستطيع معالجة هذا القدر الكبير من المعلومات، والحل لهذه المشكلة هو الذكاء الاصطناعي".

ويقدم الكتاب دليلاً مختصراً لبناء "آلة استهداف" استناداً إلى الذكاء الاصطناعي والخوارزميات، ويشتمل هذا الدليل على عدة أمثلة على المئات والآلاف من السمات التي يمكن أن تزيد إمكانية تصنيف الفرد كأحد المنتمين للحركات الفلسطينية، مثل الانضمام إلى مجموعة على تطبيق "واتساب" مع أحد المقاتلين المعروفين، أو تغيير رقم الهاتف المحمول كل بضعة أشهر، أو تغيير العناوين بشكل متكرر.

ويقول الكاتب: "كلما زادت المعلومات وتنوعت، كان ذلك أفضل، لأنه يمكن الجيش من تحديد عشرات الآلاف من الأهداف، في حين يظل القرار الفعلي بشأن مهاجمتها أم لا قراراً بشرياً".

وهذه ليست المرة الوحيدة التي يلمح فيها قائد إسرائيلي كبير إلى وجود برامج لتحديد الأهداف البشرية مثل "لافندر"، إذ حصلت المجلة على لقطات من محاضرة خاصة ألقاها قائد مركز علوم البيانات والذكاء الاصطناعي السري في "الوحدة 8200"، العقيد يوآف في أسبوع الذكاء الاصطناعي بجامعة تل أبيب عام 2023، والتي تحدث فيها عن آلة استهداف جديدة ومتطورة يستخدمها الجيش الإسرائيلي.

وتكتشف هذه الآلة، وفق العقيد يوآف، "الأشخاص الخطرين" بناءً على تشابههم مع قوائم المقاتلين المعروفة التي تم تدريبها عليها. وأضاف: "تمكنا، باستخدام هذا النظام، من التعرف على قادة فرق الصواريخ التابعة لحماس".

وتضمنت المحاضرة عرضاً، حصلت عليه المجلة، يحتوي على رسوم توضيحية لكيفية عمل هذه الآلة، إذ يتم تغذيتها ببيانات حول عناصر حماس الحاليين، والتي من خلالها تتعلم ملاحظة سماتهم، ثم تقوم بتقييم الفلسطينيين الآخرين بناءً على مدى تشابههم مع هؤلاء النشطاء.

وأكد العقيد يوآف، في المحاضرة، أنه في نهاية المطاف مَن يتخذون القرارات هم أناس من لحم ودم، ومع ذلك، فإن المصادر التي استخدمت "لافندر" في الأشهر الأخيرة تشير إلى استبدال الدقة البشرية بإنشاء الأهداف بشكل جماعي والفتك بها.

دقة لافندر

وأكد أحد كبار الضباط الذين استخدموا "لافندر"، للمجلة، أنه في الحرب الحالية، لم يُطلب من الضباط مراجعة تقييمات نظام الذكاء الاصطناعي بشكل مستقل، وذلك من أجل توفير الوقت وتمكين التحديد الضخم للأهداف البشرية دون عوائق.

وأضاف: "كان كل شيء مرتباً، ويجري وفقاً لإحصائيات، وقد تم السماح بهذا النقص في الإشراف، على الرغم من أن التقييمات الداخلية أظهرت أن قرارات لافندر كانت دقيقة بنسبة 90% فقط من الحالات، وهو ما يعني أنه كان معروفاً بشكل مسبق أن 10% من الأهداف البشرية المقرر اغتيالها لم يكونوا أعضاء في الجناح العسكري لحماس على الإطلاق".

وأوضحت المصادر أن برنامج "لافندر" قام في بعض الأحيان بالإشارة عن طريق الخطأ إلى أفراد لديهم أنماط اتصال مشابهة لنشطاء معروفين في "حماس" أو "الجهاد"، بما في ذلك أفراد الشرطة والدفاع المدني، وأقارب المقاتلين، والسكان الذين تصادف أن لديهم اسماً ولقباً متطابقين مع اسم ولقب أحد الناشطين، وسكان غزة الذين استخدموا جهازاً كان في السابق ملكاً لناشط في هذه الحركات.

وانتقد أحد المصادر عدم دقة البرنامج الآلي، قائلاً: "إلى أي مدى يجب أن يكون الشخص قريباً من حماس، حتى يعتبره الجهاز منتسباً إلى الحركة؟ الأمور تبدو غامضة، فهل الشخص الذي لا يتقاضى راتباً من حماس، لكنه يساعدها في كل الأمور، يعد ناشطاً فيها؟ وهل مَن كان تابعاً لها في الماضي ولم يعد كذلك اليوم هو ناشط فيها؟ فكل هذه السمات التي قد يشير إليها البرنامج على أنها مشبوهة هي غير دقيقة".

كما توجد مشكلات مماثلة فيما يتعلق بقدرة الأجهزة المستهدفة على تقييم الهاتف الذي يستخدمه فرد تم تحديده للاغتيال، إذ يقول أحد المصادر: "في الحرب، يقوم الفلسطينيون بتغيير هواتفهم طوال الوقت، ويفقد الناس الاتصال بأسرهم، ويعطون هواتفهم لأصدقائهم أو زوجاتهم، أو ربما حتى يفقدونها، فلا توجد طريقة للاعتماد بنسبة 100% على الآلية التلقائية التي تحدد رقم الهاتف الخاص بشخص ما".

وبحسب المصادر، كان الجيش الإسرائيلي يعلم أن الحد الأدنى من الإشراف البشري الموجود على النظام الآلي لن يكشف هذه العيوب، ولم تكن هناك سياسة "الخطأ الصفري".

100مدني مقابل قيادي في "حماس"

ونقلت المجلة عن أحد ضباط الاستخبارات، الذين استخدموا تقنية "لافندر"، قوله إنهم يثقون بهذه الآلية أكثر من ثقتهم بالجنود. وتابع: "الجميع هنا، بما فيهم أنا، فقدوا أشخاصاً في 7 أكتوبر، والآلة جعلت الأمر أسهل".

وتساءل مستخدم آخر لهذا النظام عما إذا كان دور البشر في عملية اختيار الأهداف له أهمية، قائلاً: "لم تكن لي أي قيمة مضافة كإنسان، باستثناء كوني مجرد ختم بالموافقة، لقد وفر هذا النظام الكثير من الوقت".

وفي خطوة غير مسبوقة، بحسب اثنين من المصادر، قرر الجيش الإسرائيلي أيضاً خلال الأسابيع الأولى من الحرب أن "يُسمح بقتل ما يصل إلى 15 أو 20 مدنياً مقابل كل واحد من صغار عناصر حماس يتم تحديده من قبل لافندر"، وذلك على الرغم من أن الجيش في الماضي لم يكن يسمح بوجود أي أضرار جانبية أثناء اغتيال المقاتلين ذوي الرتب المنخفضة.

وأضافت المصادر أنه في حال كان الهدف مسؤولاً كبيراً في الحركة برتبة قائد كتيبة أو لواء، أجاز الجيش في عدة حالات قتل أكثر من 100 مدني خلال اغتيال قائد واحد من هؤلاء.

وقال أحد ضباط الاستخبارات الإسرائيلية: "لا نريد أن نضيع قنابل باهظة الثمن على أشخاص غير مهمين، فهي مكلفة للغاية بالنسبة لنا، وهناك نقص في تلك القنابل".

وقال آخر إن "السؤال الرئيسي الذي كانوا يواجهونه هو ما إذا كانت الأضرار الجانبية التي تلحق بالمدنيين تسمح بشن هجوم في مكان ما"، مضيفاً: "لأننا عادةً ما ننفذ الهجمات بالقنابل الغبية، وهذا يعني حرفياً إسقاط المنزل بأكمله على ساكنيه، لكن حتى لو تم تجنب شن هجوم ما فإننا ننتقل على الفور إلى الهدف التالي، وبسبب النظام، فإن هذه الأهداف لا تنتهي أبداً، إذ لدينا 36 ألفاً آخرين بانتظارنا".

لافندر في الجيش الإسرائيلي

كانت عملية التوصل للأهداف البشرية في العمليات العسكرية السابقة، التي نفذها الجيش الإسرائيلي، تتطلب عمالة كثيفة في كثير من الأحيان، لكن المجلة نقلت عن مصادر متعددة قولها إن "قرار تجريم شخص ما، أو تحديده كهدف مشروع، في الحروب السابقة كان يجري مناقشته ثم التوقيع عليه من قبل مستشار قانوني".

لكن بعد 7 أكتوبر، تسارعت وتيرة الموافقة على شن ضربات على أهداف بشرية بشكل كبير، بحسب هذه المصادر، التي قالت إنه "مع اشتداد قصف الجيش الإسرائيلي لغزة، طالب القادة بوجود مجموعة مستمرة من الأهداف".

وقال أحد ضباط الاستخبارات: "لقد تعرّضنا لضغوط مستمرة، إذ كانوا يصرخون قائلين: أحضروا لنا المزيد من الأهداف، علينا أن نسحق حماس مهما كان الثمن، يتعين علينا القصف كلما استطعنا".

ولتلبية هذا الطلب، اعتمد الجيش الإسرائيلي بشكل كبير على نظام "لافندر" لإنشاء قاعدة بيانات للأفراد الذين يُعتقد أن لديهم سمات مقاتلي "حماس" أو "الجهاد".

وأشارت صحيفة "الجارديان" إلى أن شهادات الضباط الإسرائيليين لم تتضمن التفاصيل المتعلقة بأنواع البيانات المحددة المستخدمة لتدريب خوارزمية "لافندر" أو كيفية وصول البرنامج إلى استنتاجاته.

ولكن مصادر الصحيفة البريطانية أكدت أنه خلال الأسابيع القليلة الأولى من الحرب، قامت الوحدة 8200 بتحسين خوارزمية النظام الآلي وتعديل معايير البحث الخاصة بها، مضيفة أنه بعد أخذ عينات عشوائية والتحقق من توقعاتها، خلصت الوحدة إلى أن "لافندر" حقق معدل دقة بنسبة 90%، مما دفع الجيش الإسرائيلي إلى الموافقة على استخدامه بشكل كامل كأداة للتوصية بالاستهداف.

انتقام وعدد أكبر من الضحايا

وقبل الحرب، قدرت الولايات المتحدة وإسرائيل عدد أعضاء الجناح العسكري لحماس بنحو 25 إلى 30 ألف شخص، وفي الأسابيع التي تلت الهجوم الذي قادته حماس في 7 أكتوبر، قالت المصادر إنه كان هناك قرار بمعاملة الفلسطينيين المرتبطين بالجناح العسكري للحركة باعتبارهم أهدافاً محتملة، بغض النظر عن رتبتهم أو أهميتهم.

وأضافت المصادر أنه تم تقليل العمليات المستهدفة التي كان يقوم بها الجيش الإسرائيلي في المرحلة الأكثر كثافة من القصف، إذ قال أحد المصادر: "كانت هناك سياسة متساهلة تماماً فيما يتعلق بالتعامل مع ضحايا عمليات القصف، لدرجة أنها في رأيي كانت تحتوي على عنصر الانتقام".

وقال مصدر آخر، يبرر استخدام "لافندر" للمساعدة على تحديد الأهداف ذات الرتب المنخفضة، إنه "عندما يتعلق الأمر بأحد المقاتلين الصغار، فإنك لا ترغب في إهدار القوى البشرية والوقت معه"، لافتاً إلى أنه "في وقت الحرب لا يكون هناك وقت كافٍ لتجريم كل هدف على نحو دقيق، ولذا فإننا كنا على استعداد لتحمل هامش الخطأ في استخدام الذكاء الاصطناعي، والمخاطرة بالأضرار الجانبية وموت المدنيين، والمخاطرة بالهجوم عن طريق الخطأ، والتعايش معه".

وذكرت المجلة أنه كانت هناك تغيرات كبيرة في الرقم الذي كان القادة العسكريون يقبلونه في مراحل مختلفة من الحرب، إذ قال أحد المصادر إن الحد المسموح به من الضحايا المدنيين كان يرتفع ويهبط مع مرور الوقت، موضحاً أنه في وقت ما كان منخفضاً إلى 5 مدنيين، وفي خلال الأسبوع الأول من الحرب، تم منح الإذن بقتل 15 من غير المقاتلين للقضاء على صغار المقاتلين في القطاع، لكنهم أشار إلى أن تقدير عدد الضحايا المدنيين عادةً ما يكون غير دقيق، لأنه لم يكن من الممكن معرفة عدد الأشخاص الذين يكونون في أي مبنى بشكل محدد.

وقال ضابط استخبارات آخر إنه "في الفترة الأخيرة من الحرب انخفض معدل الأضرار الجانبية المسموح بها مرة أخرى، لكن في إحدى المراحل المبكرة من الحرب، سُمح لهم بقتل ما يصل إلى 20 مدنياً مقابل فرد واحد من حماس، بغض النظر عن رتبته أو أهميته العسكرية أو عمره".

وأضاف: "الأمر لا يقتصر على أنه يمكنك قتل أي عنصر من حماس، وهو أمر مسموح به ومشروع بشكل واضح بموجب القانون الدولي، لكنهم يقولون لك مباشرة: سيكون مسموحاً لك بقتلهم مع العديد من المدنيين، لكن عملياً، لم يكن معيار التناسب موجوداً".

تساؤلات قانونية وأخلاقية

وقالت "الجارديان" إن شهادة المصادر التي وصفتها بأنها "صريحة بشكل غير عادي" توفر لمحة نادرة من التجارب المباشرة لمسؤولي الاستخبارات الإسرائيلية الذين استخدموا أنظمة التعلم الآلي للمساعدة في تحديد الأهداف خلال الحرب المستمرة منذ 6 أشهر.

وأضافت الصحيفة أن استخدام إسرائيل لأنظمة الذكاء الاصطناعي القوية هذه في حربها على حماس يثير مجموعة من الأسئلة القانونية والأخلاقية، كما أنه يُحدث تحولاً في العلاقة بين العسكريين والآلات.

ووفقاً لخبراء الصراعات، إذا كانت إسرائيل تستخدم القنابل الغبية لتسوية منازل الآلاف من الفلسطينيين الذين تم ربطهم، بمساعدة الذكاء الاصطناعي، بالفصائل في غزة، فإن ذلك يمكن أن يساعد في تفسير عدد الضحايا المرتفع بشكل صادم في هذه الحرب.

وأعرب خبراء في القانون الإنساني الدولي، تحدثوا إلى "الجارديان"، عن قلقهم إزاء شهادات أفراد الجيش الإسرائيلي المتعلقة بالموافقة المسبقة على قتل المدنيين، خاصةً بالنسبة للمقاتلين ذوي الرتب الأدنى، قائلين إنه يجب تقييم مدى التناسب في كل ضربة على حدة.

وقال خبير بالقانون الدولي في وزارة الخارجية الأميركية، لم تكشف الصحيفة عن هويته، إنه "لم يسمع قط بأن نسبة واحد إلى 15 تعتبر مقبولة، خاصةً بالنسبة للمقاتلين من المستوى الأدنى، فهذا يبدو متطرفاً بالنسبة لي".

فيما قالت سارة هاريسون، وهي محامية سابقة في وزارة الدفاع الأميركية (البنتاجون): "رغم أنه قد تكون هناك ظروف معينة يمكن فيها أن يكون قتل 15 مدنياً متناسباً كضرر جانبي، فإن هناك أوقاتاً أخرى لن يكون الأمر فيها كذلك بالتأكيد، فلا يمكنك تحديد رقم مقبول لفئة من الأهداف والقول إنه سيكون متناسباً بشكل قانوني في كل الحالات".

وذكرت "الجارديان" أنه أياً كان المبرر القانوني أو الأخلاقي لاستراتيجية القصف الإسرائيلية، فمن الواضح أن بعض ضباط الاستخبارات الإسرائيليين يشككون الآن في النهج الذي وضعه قادتهم، إذ قال أحدهم: "لم يفكر أحد فيما يجب فعله بعد ذلك، عندما تنتهي الحرب، أو كيف سيكون من الممكن العيش في غزة بعدها".