حذرت دراسة حديثة من أخطار محتملة تتعلق بسلامة الصحة النفسية بين مستخدمي الذكاء الاصطناعي، خاصة في حالات الضيق والأفكار الانتحارية.

وأشار الباحثون إلى أن تطبيقات المحادثة الذكية أصبحت في كثير من الأحيان أول جهة يلجأ إليها الشباب للتعبير عن مشاعرهم، ما يجعل تطوير آليات وقاية فعالة داخل هذه الأنظمة أمراً ضرورياً لضمان تقديم دعم آمن ومسؤول.

وحذرت الدراسة التي نشرتها دورية Canadian Medical Association Journal من أن غياب ضوابط فعالة قد يجعل تطبيقات الذكاء الاصطناعي، خصوصاً المحادثات التفاعلية، سلاحاً ذا حدين عندما يتعلق الأمر بالأفكار الانتحارية والدعم النفسي لدى المراهقين.

وتشير بيانات حديثة إلى أن الشباب باتوا يعتمدون بشكل متزايد على ما يعرف بـ"رفقاء الذكاء الاصطناعي" كوسيلة للتعبير عن مشاعرهم أو طلب الدعم.

وأظهر استطلاع شمل أكثر من 1000 مراهق، أن نحو 72% منهم باستخدام هذه التطبيقات، بينما يستخدمها أكثر من نصفهم بشكل منتظم ما يعكس واقعاً جديداً، ما يعني أن الدعم النفسي لم يعد يبدأ من الأسرة أو المختصين، بل قد يبدأ من خوارزمية رقمية.

السلامة المدمجة

أوضحت الباحثة الرئيسية للدراسة، أليسون كروفولد، كبيرة المسؤولين الطبيين في خط المساعدة لأزمات الانتحار وأستاذة الطب النفسي في كلية تيميرتي للطب بجامعة تورنتو في كندا، أن الذكاء الاصطناعي أصبح في كثير من الحالات "نقطة الاتصال الأولى" مع مشاعر الضيق قبل أن يلاحظها المحيطون بالشخص أحياناً.

ويتقاطع هذا الواقع مع مفاهيم في علم النفس مثل "البحث عن الدعم" و"التنظيم العاطفي" إذ يلجأ الأفراد إلى مصادر خارجية للتخفيف من التوتر.

وتشير دراسات سابقة إلى أن القدرة على التعبير عن المشاعر - في بيئة غير بشرية - قد تقلل من الشعور بالعزلة، وهنا تظهر إحدى مزايا الذكاء الاصطناعي؛ فهو متاح على مدار الساعة، ولا يصدر أحكاماً، وقد يوفر مساحة آمنة نسبياً للتعبير.

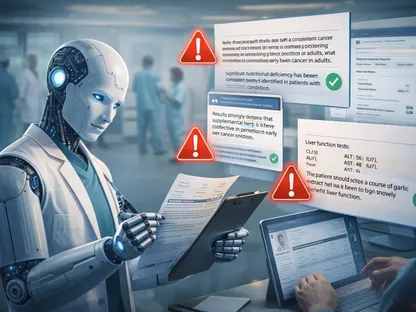

لكن في المقابل، تكمن المخاطر في تصميم هذه الأنظمة؛ فالتعليقات العلمية تحذر من أن الأنظمة غير المصممة بعناية قد تفشل في التعرف على إشارات الخطر، أو تتعامل معها بطريقة غير مناسبة، ما قد يؤدي إلى تفاقم الحالة بدلاً من احتوائها.

وتؤكد الدراسات أن الاستجابات غير الدقيقة أو المضللة في لحظات الأزمات النفسية قد تكون لها عواقب حقيقية، خاصة لدى الأفراد الأكثر هشاشة.

أوضحت كروفولد أن مفهوم "السلامة المدمجة" يجب أن يظهر في تصميم الذكاء الاصطناعي، وهو نهج يعتمد على إدخال آليات وقائية داخل النظام نفسه، مشيرة إلى أن هذه الآليات تشمل القدرة على التعرف على اللغة المرتبطة بالأفكار الانتحارية، وتقديم استجابات داعمة، وتوجيه المستخدمين نحو مصادر مساعدة حقيقية مثل الأصدقاء أو العائلة أو المختصين.

وتؤكد الدراسات أن أفضل النتائج تتحقق عندما يكون الذكاء الاصطناعي جزءاً من منظومة دعم أوسع، وليس بديلاً عنها.

جزء من التجربة الإنسانية

وتدعم هذه الرؤية دراسات في الصحة العامة تشير إلى أن الوقاية من الانتحار تعتمد بشكل أساسي على تقوية الروابط الاجتماعية، وتسهيل الوصول إلى الدعم المهني، والتدخل المبكر؛ لذلك، فإن الدور المثالي للذكاء الاصطناعي لا يتمثل في "حل" المشكلة، بل في أن يكون جسراً يربط المستخدم بالمساعدة البشرية المناسبة في الوقت المناسب.

ودعا الباحثون إلى تطوير نماذج أكثر تقدماً قادرة على فهم السياق العاطفي بدقة، مع تدريبها على بيانات متنوعة وآمنة، وإشراك خبراء الصحة النفسية في تصميمها، مشددين على أهمية وجود أطر قانونية وأخلاقية تحكم استخدام هذه التقنيات، خاصة عندما يتعلق الأمر بفئات حساسة مثل الأطفال والمراهقين.